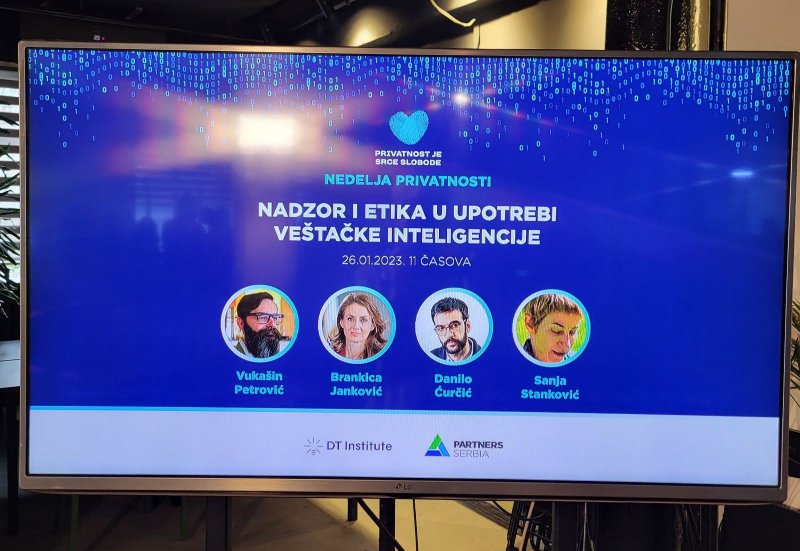

Veštačka inteligencija je tu i sve će se više primenjivati. Na svima nama je da tu činjenicu prihvatimo i nađemo način kako da se sa tim ispravno nosimo. Dosta kasnimo i nema vremena za duge rasprave dok se svet oko nas vrtoglavo menja, rekla je poverenica za zaštitu ravnopravnosti Brankica Janković na panelu “Nadzor i etika u upotrebi veštačke inteligencije” održanom tokom Nedelje privatnosti koju organizuju Partneri Srbije.

Poverenica je navela da je sve šira upotreba veštačke inteligencije pokrenula dramatične promene koje nas očekuju u svim oblastima života, noseći sa sobom potencijalne dobitke ali i rizike od diskriminacije i kršenja ljudskih prava, zbog čega je neophodno postaviti odgovarajuće principe obrade podataka, kreiranja algoritama i kontrole,

S obzirom na to da će se socijalne, zdravstvene i ekonomske usluge, ali i tržište rada, sve više oslanjati na automatizaciju, kako u privatnom tako i u javnom sektoru, kao i da se kršenja prava od strane algoritama teško otkrivaju, što može pogoditi ogroman broj ljudi, poverenica ističe da je neophodno uključiti pripadnike različitih društvenih grupa u kreiranje ovakvih programa, kako bi svojom specifičnom perspektivom doprineli inkluzivnosti procesa, “čišćenju” podataka, i eliminaciji predrasuda iz algoritama I kodova. Neophodno je da podižemo svest među tehničkom zajednicom o rizicima, opasnostima, ali i da gradimo njihove kapacitete o osnovnim pojmovima prepoznavanja i reagovanja na diskriminaciju, dodala je Janković.

Poverenica je navela i podatke iz Izveštaja o stanju predrasuda u veštačkoj inteligenciji, jedne od vodećih kompanija iz oblasti veštačke inteligencije DataRobot koji je izrađen u saradnji sa Svetskim ekonomskim forumom i globalnim akademskim liderima, da mnogi menadžeri najvećih svetskih kompanija dele duboku zabrinutost oko rizika od pristrasnosti u sistemima veštačke inteligencije (54%) i očekuju da ih nacionalni pravni okvir predupredi (81%). Iako su mnoge kompanije razvile interne mehanizme za eliminaciju predrasuda i diskriminacije mora se uzeti u obzir da i oni imaju svoja ograničenja usled nemogućnosti za prepoznavanje konteksta i drugih apstraktnijih pojmova, istakla je poverenica.

Imajući u vidu sve navedeno, kreiranje pravičnih algoritama i korišćenja podataka neće biti jednostavan process, ali verujem da će se mehanizmi kontrole vremenom kristalisati I ujednačavati, kao i da će se potencijalni diskriminatorni ishodi rutinski proveravati u relevantnim institucijama kao što je Poverenik, zaključila je poverenica Janković.